自動化

2026年3月13日

本番AI運用プレイブック:暴走を防ぐ「人間の監視」3つの実践パターン

n8nが公開した最新のProduction AI Playbookを翻訳・解説。AIワークフローに人間の承認を組み込む3つの実装パターンを、Humanoidの見解と共にご紹介します。

#n8n

#automation

#workflow

「AIエージェントを本番投入したら、ありえない90%割引を顧客に約束してしまった…」

これは笑い話ではありません。AIワークフローを本番環境にデプロイしたチームが、遅かれ早かれ直面する現実です。AIの能力は非常に高いですが、**監視(Oversight)**なき能力は、もはやビジネス上の負債でしかありません。

2026年3月9日にn8nが公開したブログ記事「Production AI Playbook: Human Oversight」は、この「制御の問題」に正面から向き合い、AIのスピードを殺さずに人間の判断を組み込むための具体的な設計パターンを提示しています [1]。

本記事では、このn8nの最新プレイブックを翻訳・要約し、私たちHumanoidが考える「日本企業が実践すべきAIの監視体制」についての見解を加えて解説します。

なぜ「人間の監視」が不可欠なのか?

n8nは、AIワークフローにおける人間の監視が不可欠なシナリオとして、以下の3つを挙げています。

| 監視が必要なシナリオ | 具体例 | Humanoidの見解 |

|---|---|---|

| ① ハイステークスな出力 | 顧客やパートナー、一般に公開されるコンテンツ(契約書、プレスリリース等) | AIの生成物は「下書き」と位置づけ、最終的な意思決定は必ず人間が行うべき。特に法務・広報関連はリスクが高い。 |

| ② 不可逆なアクション | データベースの書き込み、金融取引、アカウントの変更・削除 | 「実行前に必ず確認」を徹底。操作ログの記録も必須。n8nの承認フローは、内部統制の観点からも極めて有効。 |

| ③ 未知・曖昧な入力 | AIの確信度が低い、過去に例のない問い合わせ | AIが「分からない」と判断した際に、人間にエスカレーションするルートを確保することが、ハルシネーション(幻覚)を防ぐ鍵。 |

表1: n8nのブログ[1]に基づく「人間の監視」が必要な3つのシナリオと弊社の見解

重要なのは、AIの全ての出力を人間がチェックするのではなく、「重要な瞬間」にだけ人間が介入するようにワークフローを設計することです。これにより、自動化のメリットを享受しつつ、致命的なミスを防ぐことができます。

n8nが提唱する「人間の監視」3つの実践パターン

n8nは、これらのシナリオに対応するための具体的な実装パターンを3つ紹介しています。

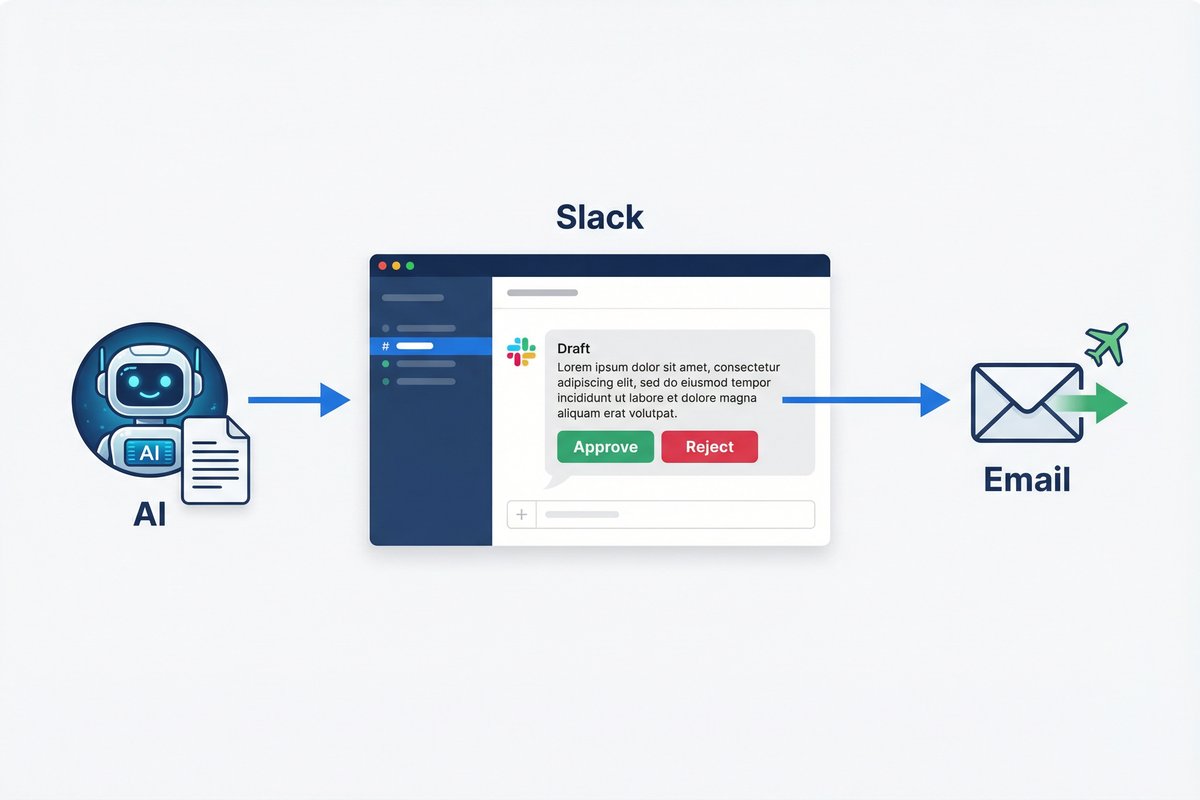

パターン1:インライン・チャット承認

最もシンプルで直接的な方法です。AIが出力を生成した後、SlackやTeamsなどのチャットツール上で人間に「承認/否認」を求め、承認されて初めて次のアクション(メール送信など)が実行されます。

Humanoidの見解: このパターンは、顧客サポートのメール返信案レビューや、SNS投稿内容の最終チェックなど、リアルタイム性が求められる業務に最適です。n8nのChat Nodeに新たに追加された「Send and Wait for Response」機能を使えば、驚くほど簡単に実装できます。

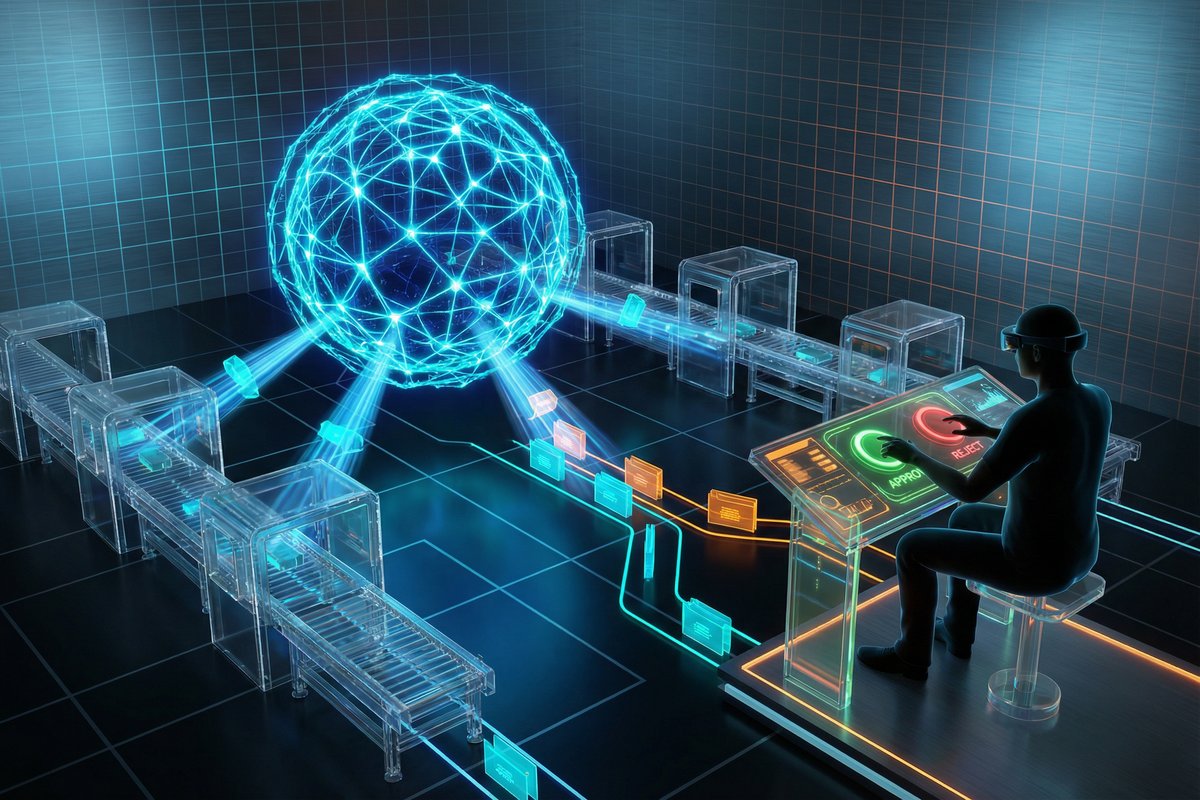

パターン2:ツールコール承認ゲート

AIエージェントがデータベース更新やCRM操作などの「ツール」を呼び出す直前に、承認ゲートを設けるパターンです。n8nのAI Agent Nodeでは、ツール定義にrequireApproval: trueと設定するだけで、ツール実行前に人間の承認を必須にできます。

Humanoidの見解: これは「不可逆なアクション」に対する非常に強力な安全装置です。例えば、「AIが顧客ID『A001』のステータスを『解約』に変更しようとしています。承認しますか?」といった確認を挟むことで、誤操作による重大なデータ損失を防ぎます。内部統制のログとしても活用できるでしょう。

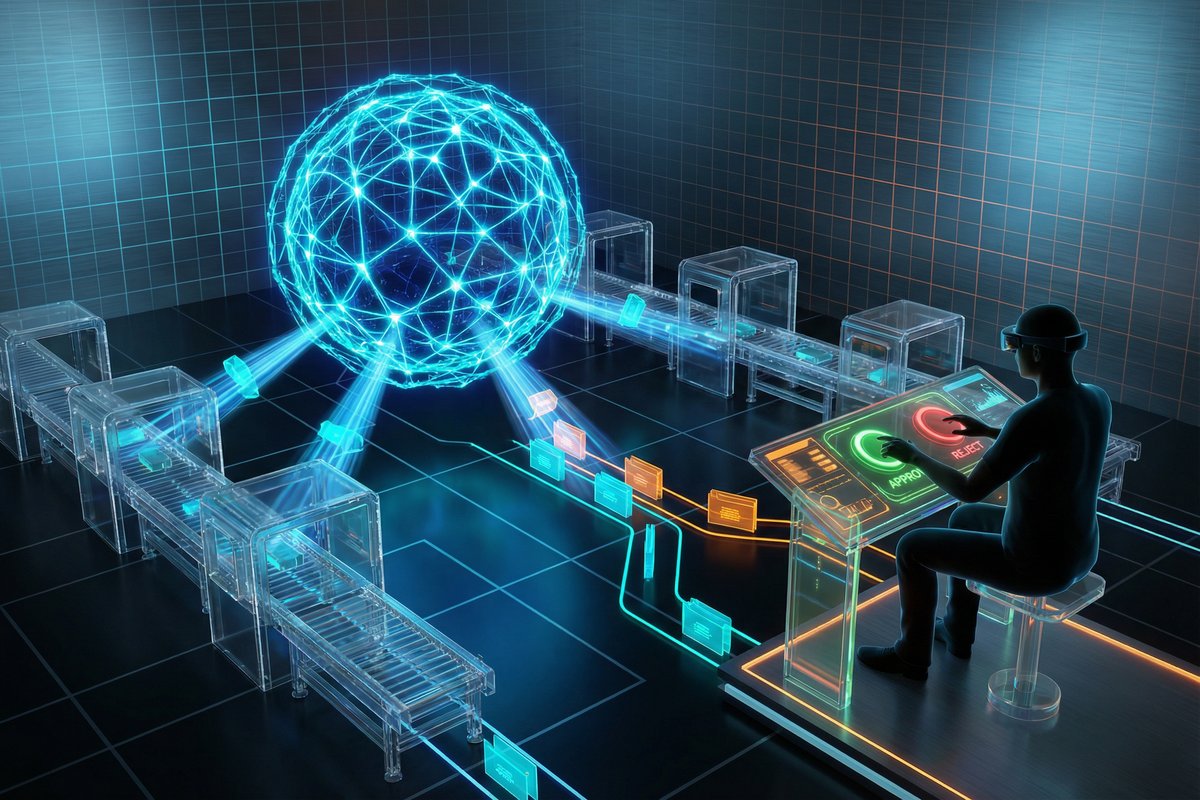

パターン3:マルチチャネル・レビューワークフロー

契約書のレビューのように、複数の承認者や複数の部署が関わる、より複雑な承認フローです。最初のレビューは法務部がSlackで行い、次のレビューは営業部長がメールで行う、といった多段階のワークフローを構築します。

Humanoidの見解: 日本の大企業で求められる稟議プロセスやワークフローにも十分対応できる、拡張性の高いパターンです。n8nの強みである「あらゆるツールを連携できる」点を最大限に活かせます。タイムアウト(例: 4時間以内に承認されない場合は部長にエスカレーション)を設定することも重要です。

まとめ:AIを「賢い部下」として使いこなすために

AIを導入する目的は、業務を効率化し、人間がより創造的な仕事に集中できるようにすることです。しかし、AIを「野放し」にしてしまっては、かえって大きなリスクを生み出すことになりかねません。

今回n8nが示した3つのパターンは、AIを信頼できる「賢い部下」としてチームに迎え入れるための、非常に実践的なガイドラインです。AIに自律性を与えつつも、重要な意思決定の最終責任は人間が持つ。この「主従関係」をワークフローレベルで設計することが、AI時代のリスクマネジメントの鍵となります。

私たちHumanoidは、n8n公認パートナーとして、こうした高度な承認フローを含む、安全で信頼性の高いAIワークフローの設計・構築を支援しています。AIの導入に際して、その「制御」に不安を感じている方は、ぜひ一度ご相談ください。

参考文献

[1] n8n. "Production AI Playbook: Human Oversight". n8n Blog. 2026-03-09. https://blog.n8n.io/production-ai-playbook-human-oversight/, (参照 2026-03-13).